Резюме доклада

В случаях, не предусмотренных настоящим Протоколом или другими международными соглашениями, гражданские лица и комбатанты остаются под защитой и действием принципов международного права, проистекающих из установившихся обычаев, принципов гуманности и требований общественного сознания.

– Оговорка Мартенса, как указано в Протоколе I к Женевским конвенциям в 1977 году

Полностью автономные оружейные системы являются одной из самых опасных военных технологий, которые разрабатываются в настоящее время. В связи с этим существует настоятельная необходимость того, чтобы государства, эксперты и общественность тщательно изучили эти оружейные системы с точки зрения оговорки Мартенса, уникального положения международного гуманитарного права, которое устанавливает основу защиты гражданских лиц и комбатантов, когда нет какого-либо конкретного договорного права, которое можно применить в ситуации. В этом докладе рассматривается вопрос о том, что полностью автономные оружейные системы, которые смогут выбирать и поражать цели без значимого контроля со стороны человека, противоречат обеим составляющим оговорки Мартенса: принципам человечности и требованиям общественного сознания. В соответствии с оговоркой Мартенса, государствам следует принять упреждающий запрет на разработку, производство и применение данных оружейных систем.

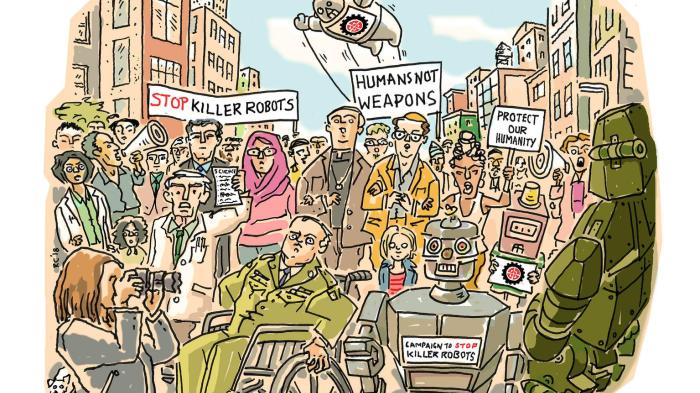

Быстрое развитие автономных технологий и искусственного интеллекта (ИИ) означает, что полностью автономные оружейные системы могут стать реальностью в обозримом будущем. Эти оружейные системы, также известные как «роботы-убийцы» и автономные системы оружия летального действия, поднимают множество вопросов морального, правового, подотчетного, оперативного, технического характера и вопросов безопасности. Данные оружейные системы являются предметом обсуждений на международной арене с 2013 года. В том же году началась кампания «Остановить роботов-убийц», коалиция гражданского общества, которая стала призывать государства к обсуждению этого вида оружия. После проведения трех неофициальных заседаний экспертов, государства-участники Конвенции по конкретным видам обычного оружия (Конвенция о «негуманном» оружии, КНО) начали официальные переговоры по этому вопросу в 2017 году. В августе 2018 года примерно 80 государств вновь соберутся на следующем заседании Группы правительственных экспертов КНО.

При оценивании государствами-участниками КНО полностью автономных оружейных систем и их будущего, оговорка Мартенса должна быть центральным элементом обсуждений. Данная оговорка, которая является общим признаком международного гуманитарного права и договоров о разоружении, заявляет, что в отсутствие международного соглашения, установившиеся обычаи, принципы человечности и требования общественного сознания должны обеспечивать защиту гражданских лиц и комбатантов. Эта оговорка применяется к полностью автономным оружейным системам, поскольку они не рассматриваются конкретным международным правом. Мнения экспертов в отношении точного юридического значения оговорки Мартенса расходятся, некоторые считают, что оговорка повторно напоминает о соблюдении обычного права, для других она является независимым источником права, либо служит инструментом толкования существующих договоров. Однако, как минимум, оговорка Мартенса представляет для рассмотрения ключевые факторы при оценивании государствами оружия новейших технологий, включая полностью автономные оружейные системы. Оговорка создает моральный стандарт, с помощью которого оцениваются оружейные системы.

Принципы гуманности

Из-за отсутствия у полностью автономных оружейных систем эмоций, правовых и этических суждений возникают серьезные препятствия в отношении соблюдения принципов человечности. Эти принципы требуют гуманного отношения к другим и уважения к человеческой жизни и человеческому достоинству. Люди мотивированы относиться друг к другу гуманно, потому что они чувствуют сострадание и сочувствие к своим ближним. Правовое и этическое суждение для людей, являясь средством минимизации вреда, позволяет им принимать взвешенные решения на основе понимания конкретной ситуации. Являясь машинами, полностью автономные оружейные системы не смогут стать разумными существами, способными чувствовать сострадание. Вместо здравого суждения, такие оружейные системы будут основывать свои действия на запрограммированных алгоритмах, которые плохо подходят в сложных и непредсказуемых ситуациях.

Признание уважения к человеческой жизни влечет за собой минимизацию убийства. Правовое и этическое суждение помогает людям взвешивать различные факторы, чтобы предотвратить произвольные и неоправданные потери жизни при вооруженных конфликтах и в других ситуациях. Для полностью автономных оружейных систем будет сложно разработать такое суждение, которое формировалось как на протяжении всей истории человечества, так и в течение жизни каждого человека; невозможно предварительно запрограммировать в машинные системы все вероятные сценарии в соответствии с принятыми правовыми и этическими нормами. Кроме того, у большинства людей есть врожденное сопротивление убийству, основанное на их понимании эффекта от потери жизни, которого не может быть у полностью автономных оружейных систем, так как это неодушевленные машины.

Даже если бы полностью автономные оружейные системы могли в достаточной мере защитить человеческую жизнь, они все равно неспособны были бы проявлять уважение к человеческому достоинству. В отличие от людей, эти роботы не смогут в полной мере оценить ценность человеческой жизни и значимость ее потери. Они будут принимать решения о жизни и смерти на основе алгоритмов, сведя свои живые цели к объектам. Таким образом, полностью автономные оружейные системы нарушают принципы человечности во всех направлениях.

Требования общественного сознания

Возрастающее недовольство перспективой использования полностью автономных оружейных систем говорит о том, что эта новая технология также противоречит второй составляющей оговорки Мартенса – требованиям общественного сознания. Эти требования состоят из моральных принципов, основанных на знании того, что правильно и что неправильно. Они могут утверждаться через мнения общественности и правительств.

Многие личности, эксперты и правительства стран решительно возражают против полностью автономных оружейных систем. Большинство респондентов в многочисленных опросах общественного мнения высказались против этого вида оружия. Эксперты, которые прорабатывали этот вопрос более детально, опубликовали открытые письма и заявления, отражающие мнение общественности даже лучше, чем опросы. Международные организации и неправительственные организации (НПО), наряду с лидерами в области разоружения и прав человека, мира и религии, науки и техники, промышленности, считают настоятельно необходимым требовать запрета полностью автономных оружейных систем, особенно, исходя из моральных соображений. Они осудили эти оружейные системы, высказав, что такое оружие является «противоречащим здравому смыслу», «чудовищным ... по отношению к священной сущности жизни», «неразумным» и «неэтичным».

Главные проблемы в ситуации с полностью автономными оружейными системами, на которые ссылаются правительства, это несоблюдение оговорки Мартенса и отсутствие моральных качеств. По состоянию на июль 2018 года 26 государств поддержали упреждающий запрет, более 100 государств призвали к принятию юридически обязательного документа для решения проблем, связанных с автономными системами оружия летального действия. Почти каждое государство-участник КНО, которое выступало на последнем совещании в апреле 2018 года, подчеркнуло необходимость сохранения значимого контроля со стороны человека при применении вооруженной силы. Возникающий консенсус в отношении сохранения значимого контроля со стороны человека, который фактически эквивалентен запрету на оружие, которое не имеет такого контроля, показывает, что общественное сознание решительно против полностью автономных оружейных систем.

Необходимость в договоре об упреждающем запрете

Оценка полностью автономных оружейных систем в соответствии с оговоркой Мартенса подчеркивает необходимость в новом законе, который будет как достаточно конкретным, так и сильным. Одного регламента, допускающего существование полностью автономных оружейных систем, недостаточно. Например, ограничение использования в определенных местностях не позволяет предотвратить риск распространения среди субъектов, которые мало учитывают человеческое обращение или жизнь людей, а также не уважают достоинства гражданских лиц или комбатантов. Кроме того, общественность заявляет о поддержке запрета на полностью автономные оружейные системы или их эквиваленты – требование значимого контроля со стороны человека. Для обеспечения соблюдения принципов человечности и требований общественного сознания государства должны упреждающе запрещать разработку, производство и использование полностью автономных оружейных систем.

Рекомендации

Для предотвращения юридических, моральных и других рисков, создаваемых полностью автономными оружейными системами, и потери значимого контроля со стороны человека над выбором целей и их поражением, Хьюман Райтс Вотч и Международная клиника прав человека (МКПЧ) Гарвардской школы права рекомендуют:

Государствам-участникам КНО

- На своем ежегодном совещании в ноябре 2018 года принять мандат о проведении переговоров по новому протоколу, запрещающему полностью автономные оружейные системы или автономные системы оружия летального действия, с целью завершения переговоров к концу 2019 года.

- Использовать промежуточное заседание Группы правительственных экспертов в августе 2018 года для представления четких национальных позиций и прийти к согласию относительно необходимости принятия мандата о проведении переговоров на ежегодном совещании в ноябре.

- Разработать национальные позиции и принять национальные запреты в качестве ключевых блоков для международного запрета.

- Выразить протест в отношении полностью автономных оружейных систем, в том числе исходя из юридических и моральных соображений, отраженных в оговорке Мартенса, в целях дальнейшего развития существующего общественного сознания.

Экспертам в частном секторе

- Противостоять смещению значимого контроля при применении вооруженной силы от человека к оружейным системам.

- Публично выразить явную поддержку призыву запретить полностью автономные оружейные системы, в том числе исходя из юридических и моральных соображений, отраженных в оговорке Мартенса, и настоятельно призвать правительства начать переговоры о новом международном договоре.

- Дать обязательство не разрабатывать и не использовать ИИ при проектировании полностью автономных оружейных систем, используя кодексы этических норм, заявления о принципах и другие меры, гарантирующие, что частный сектор не будет заниматься разработкой, производством или использованием полностью автономных оружейных систем.

I. Вводная информация о полностью автономных оружейных системах

Полностью автономные оружейные системы смогут выбирать и поражать цели без значимого контроля со стороны человека. Это неприемлемый этап, он идет еще дальше, чем применение уже существующих беспилотных летательных аппаратов с летальным вооружением на борту, поскольку человек не будет принимать окончательного решения об использовании силы в отдельных атаках. Таких полностью автономных оружейных систем, также известных как автономные системы оружия летального действия и «роботы-убийцы», пока не существует, но они находятся в стадии разработки, а военные инвестиции в автономные технологии растут с угрожающей скоростью.

Риски полностью автономных оружейных систем перевешивают их предполагаемые выгоды. Сторонники данных систем вооружений подчеркивают, что новая технология может спасать жизни солдат, обрабатывать данные и работать на больших скоростях, чем традиционные системы, будет неуязвимой к страху и гневу, которые могут привести к жертвам среди гражданского населения. Однако полностью автономные оружейные системы поднимают массу серьезных вопросов, многие из которых, как подчеркивает Хьюман Райтс Вотч, были опубликованы в предыдущих публикациях. Во-первых, передача машинам решений по вопросам жизни и смерти выходит за пределы морали. Во-вторых, полностью автономные оружейные системы сталкиваются с серьезными проблемами несоответствия международному гуманитарному праву и правам человека. В-третьих, они создадут разрыв на уровне подотчетности, потому что будет трудно привлечь кого-то к ответственности за непредвиденный вред, причиненный автономным роботом. В-четвертых, полностью автономное оружие будет уязвимым для подмены и взлома системы. В-пятых, это оружие поставит под угрозу глобальную безопасность, поскольку такие системы могут привести к гонке вооружений, распространиться среди субъектов, которые не соблюдают международное право, и приведут нас к войне.[1]

В этом докладе внимание уделяется еще одной проблеме, которая затрагивает право и мораль, то есть вероятность того, что полностью автономные оружейные системы будут противоречить оговорке Мартенса. Это положение международного гуманитарного права требует от государств учитывать принципы человечности и требования общественного сознания при изучении новых технологий вооружений. Общей чертой Женевских конвенций и договоров в области разоружения является то, что оговорка представляет собой юридическое обязательство государств учитывать моральные аспекты.

Множество проблем, создаваемых полностью автономными оружейными системами, в том числе в соответствии с оговоркой Мартенса, требуют срочных действий. Несколько стран предложили применить выжидательный подход, учитывая тот факт, что пока неясно, что смогут достичь технологии. Тем не менее, высокие риски указывают на необходимость принятия мер предосторожности. Научная неопределенность не должна мешать действиям по предотвращению того, что некоторые ученые назвали «третьей революцией в войне, после пороха и ядерного оружия».[2] Страны должны принять упреждающий запрет на разработку, производство и использование полностью автономных оружейных систем.

II. История оговорки Мартенса

Оговорка Мартенса, возникшая в результате дипломатического компромисса, служила гуманитарным целям. В ней говорится, что в отсутствие конкретного договорного права, установившиеся обычаи, принципы гуманности и требования общественного сознания обеспечивают защиту гражданских лиц и комбатантов. С момента своего появления оговорка Мартенса стала общей характеристикой основных инструментов международного гуманитарного права. Эта оговорка также фигурирует в многочисленных договорах по разоружению. Защиты, которые дает оговорка Мартенса, и юридическое признание, которое она получила, подчеркивают ее ценность при исследовании новых оружейных систем, которые могут причинить гуманитарный вред на поле военных действий и за его пределами.

Происхождение оговорки Мартенса

Оговорка Мартенса впервые появилась в преамбуле Гаагской конвенции 1899 года, в которой содержится Положение о законах и обычаях сухопутной войны. В этом варианте оговорка Мартенса гласит:

Впредь до того времени, когда представится возможность издать более полный свод законов войны, Высокие Договаривающиеся Стороны считают уместным засвидетельствовать, что в случаях, не предусмотренных принятыми ими постановлениями, население и воюющие остаются под охраною и действием начал международного права, поскольку они вытекают из установившихся между образованными народами обычаев, из законов человечности и требований общественного сознания.[3]

Таким образом, оговорка обеспечивает базовый уровень защиты гражданских лиц и комбатантов, когда не существует конкретного закона.

Российский дипломат и юрист Федор Федорович Мартенс предложил оговорку Мартенса как способ выйти из переговорного тупика на Гаагской мирной конференции 1899 года, которая была созвана для принятия правил, сдерживающих войну, для сокращения расходов на вооружение и содействия миру.[4] Великие державы и меньшие государства не могли договориться о том, до какой степени оккупационные силы могли применять силу над местным населением. Великие державы настаивали на новом договоре, разъясняющем права и обязанности оккупационных сил, тогда как меньшие державы выступали против принятия положений политической декларации, которая, по их мнению, не обеспечивала положенной защиты гражданских лиц. Оговорка Мартенса предоставила борцам против иностранной оккупации возможность заявить, что в случае, если конкретные положения договора не применяются к их ситуации, они имеют право, по крайней мере, на такую защиту, предлагаемую принципами международного права, вытекающими из обычаев, «законов человечности» и «требований общественного сознания».[5]

Современное применение оговорки Мартенса

За почти 120 лет со времени принятия Гаагской конвенции 1899 года оговорка Мартенса применяется все больше и становится основным средством распространения гуманитарной защиты во время вооруженного конфликта. Стремясь уменьшить последствия военных действий, многочисленные инструменты международного гуманитарного права и права в области разоружения включили данную оговорку.

Женевские конвенции и Дополнительный протокол I

При разработке Женевских конвенций 1949 года, фундаментальных элементов международного гуманитарного права,[6] участники переговоров хотели обеспечить продолжения некоторых мер защиты, если государство-участник решит выйти из любого из договоров. Четыре Женевские конвенции содержат оговорку Мартенса в своих статьях о денонсации, в которых рассматриваются последствия, связанные с выходом страны из договоров.[7] В своем авторитетном комментарии к конвенциям Международный комитет Красного Креста (МККК), арбитр международного гуманитарного права, объясняет:

[В случае если] Высокая Договаривающаяся Сторона собирается денонсировать одну из Женевских конвенций, она по-прежнему будет связана не только другими договорами, Стороной которых она остается, но и другими нормами международного права, такими как обычное право. Таким образом, argumentum e contrario, предлагающее правовой вакуум после денонсации Конвенции, не представляется возможным.[8]

Дополнительный протокол I, который был принят в 1977 году, расширяет защиту, предоставляемую гражданским лицам Четвертой Женевской конвенцией[9]. Протокол содержит современную трактовку оговорки Мартенса и версию, используемую в этом докладе:

В случаях, не предусмотренных настоящим Протоколом или другими международными соглашениями, гражданские лица и комбатанты остаются под защитой и действием принципов международного права, проистекающих из установившихся обычаев, принципов гуманности и требований общественного сознания[10].

Включив эту формулировку в свою статью «Общие принципы и область применения», вместо того, чтобы ограничить ее положением о денонсации, Дополнительный протокол I расширяет применение оговорки Мартенса. Согласно комментарию МККК:

Было две причины, по которым было сочтено полезным включить данную оговорку еще раз в Протокол. Во-первых, ... никакая кодификация не может быть полной в любой конкретный момент; в этой связи оговорка Мартенса исключает предположение, что всё, что прямо не запрещено относимыми договорами, является по этой причине разрешенным. Во-вторых, она должна рассматриваться как динамический фактор, провозглашающий применимость указанных принципов, независимо от дальнейшего развития типов ситуаций или технологий.[11]

Таким образом, оговорка Мартенса закрывает пробелы в существующем законодательстве и способствует защите гражданского населения в новой ситуации или при появлении новой технологии.

Договоры о разоружении

С 1925 года большинство договоров, содержащих запреты на оружие, также включают в себя оговорку Мартенса[12]. Эта оговорка упоминается в различных формах в преамбулах Женевского протокола о газах 1925 года[13], Конвенции 1972 года о биологическом оружии[14], Конвенции 1980 года о конкретных видах обычного оружия[15], Конвенции 1997 года о запрещении противопехотных мин[16], Конвенции о кассетных боеприпасах[17] и Договора о запрещении ядерного оружия 2017 года[18]. Хотя преамбула не устанавливает обязательных правил, она может информировать о толковании договора и обычно используется для включения в контекст уже существующего закона. Включение оговорки Мартенса указывает на то, что если в действующих положениях договора имеются пробелы, они должны быть охвачены установившимися обычаями, принципами человечности и требованиями общественного сознания. Включив оговорку Мартенса в договоры о разоружении, государства вновь подтвердили ее важность для международного гуманитарного права в целом, и для закона о вооружении, в частности.

Широкое применение оговорки Мартенса делает ее актуальной для нынешних обсуждений полностью автономных оружейных систем. Оговорка предоставляет стандарт для обеспечения гражданских лиц и комбатантов, по меньшей мере, минимальной защитой от такого проблемного оружия. Кроме того, большинство дипломатических дискуссий о полностью автономных оружейных системах проходили под эгидой КНО, которая включает оговорку Мартенса в свою преамбулу. Поэтому оценка полностью автономных оружейных систем в соответствии с оговоркой Мартенса должна играть ключевую роль в обсуждении нового протокола КНО.

III. Применимость и значение оговорки Мартенса

Оговорка Мартенса применяется в отсутствие конкретного закона в той или иной ситуации. Эксперты расходятся во мнении касательно ее юридической значимости, но, как минимум, она озвучивает те факторы, которые должны учитываться государствами при рассмотрении новых задач, возникающих в связи с появлением новых технологий. В частности, ее значимость для закона о разоружении очевидна при переговорах, которые привели к принятию упреждающего запрета на ослепляющие лазеры. Поэтому государства и другие заинтересованные стороны должны учитывать эту оговорку при обсуждении законности полностью автономных оружейных систем и того, как наилучшим образом решить проблемы в отношении такого оружия.

Применимость оговорки Мартенса

Оговорка Мартенса, как указано в Дополнительном протоколе I, применяется «[в] случаях, не предусмотренных» протоколом или другими международными соглашениями.[19]Независимо от того, насколько составители договоров внимательны, они не могут предвидеть и охватить все обстоятельства в одном документе. Оговорка Мартенса служит стопроцентной мерой обеспечения того, что непредвиденная ситуация или новые возникающие технологии не подорвут общую цель гуманитарного права только потому, что никакое существующее положение договора явно их не предусматривает.[20]

Оговорка Мартенса инициируется, когда существующее договорное право конкретно не затрагивает определенные обстоятельства. Как объяснил Военный трибунал США в Нюрнберге, оговорка преобразует «обычаи, установившиеся между образованными народами, законы человечности и требования общественного сознания в юридический критерий, применяемый, если и когда конкретные положения [действующего закона] не охватывают конкретные случаи, происходящие при военных действиях».[21] Это особенно актуально для новых технологий, о которых разработчики существующего законодательства, возможно, и не подозревали. Подчеркивая, что «постоянное существование и применимость статьи не подлежит сомнению», Международный Суд сделал акцент на том, что она «оказалась эффективным средством борьбы с быстрой эволюцией военных технологий».[22] Учитывая, что часто в этой сфере наблюдается нехватка законов, оговорка Мартенса обеспечивает стандарт для нового оружия.

Являясь быстро развивающейся формой технологии, полностью автономные оружейные системы служат подходящим примером для применения оговорки Мартенса. Действующее международное гуманитарное право распространяется на полностью автономные оружейные системы только в общих чертах. Это право требует соответствия всего оружия основным принципам разграничения и пропорциональности, но в нем не содержится конкретных правил для борьбы с полностью автономными оружейными системами.[23] Разработчики Женевских конвенций не могли предвидеть перспективу робота, который сможет самостоятельно определять, когда применять силу без значимого контроля со стороны человека. Учитывая, что полностью автономные оружейные системы представляют собой случай, не предусмотренный действующим законодательством, их следует оценивать в соответствии с принципами, изложенными в оговорке Мартенса.

Юридическое значение оговорки Мартенса

Интерпретации юридического значения оговорки Мартенса различаются.[24]Некоторые эксперты придерживаются узкой точки зрения, утверждая, что оговорка Мартенса служит лишь напоминанием о том, что если в договоре не предусматривается явный запрет на конкретное действие, это не значит, что действие автоматически разрешается. Другими словами, государства должны ссылаться на обычное международное право, когда договорное право ничего не говорит по конкретному вопросу.[25] Однако эта точка зрения, по мнению некоторых, является неудовлетворительной, поскольку она касается только одного аспекта оговорки установившихся обычаев и не учитывает роль принципов гуманности и требований общественного сознания. В соответствии с общепринятыми правилами юридической интерпретации, оговорку необходимо интерпретировать, чтобы дать смысл каждому из ее терминов.[26] Рассмотрение принципов гуманности и требований общественного сознания как простых элементов установившихся обычаев сделает их излишними и нарушит это правило.

Другие утверждают, что оговорка Мартенса сама по себе является уникальным источником права.[27] Они говорят, что простой язык оговорки Мартенса поднимает принципы гуманности и требования общественного сознания до независимых правовых стандартов, по которым можно оценивать непредвиденные ситуации и новые формы военной технологии.[28] Исходя из этого, ситуация или оружейные системы, которые противоречат стандарту, являются незаконными по своей сути.

Юрист международного публичного права Антонио Кассезе применил промежуточный подход, рассматривая принципы гуманности и требования общественного сознания как «фундаментальное руководство» для толкования международного права.[29] Кассезе писал, что «в случае сомнений международные правила, в частности, нормы, относящиеся к гуманитарному праву, должны толковаться так, чтобы они соответствовали общим стандартам гуманности и требованиям общественного сознания».[30]Поэтому международное право следует понимать для того, чтобы не оправдывать ситуации или технологии, которые вызывают беспокойство в связи с этими элементами оговорки Мартенса.

Как минимум, оговорка Мартенса озвучивает те факторы, которые государства должны учитывать по мере приближения к новым технологиям вооружения, включая полностью автономные оружейные системы. В 2018 году МККК заявил, что идут «дебаты о том, является ли оговорка Мартенса юридически обязывающим критерием, по которому должна измеряться законность оружия, или это, скорее, этическое руководство».[31]Однако был сделан вывод, что «понятно, что соображения гуманности и общественного сознания привели к эволюции международного права в отношении оружия, и эти понятия вызвали переговоры по конкретным договорам о запрещении или ограничении определенного оружия».[32] Если опасения по поводу оружия возникают в соответствии с принципами гуманности или требований общественного сознания, принятие нового, более конкретного закона, который устраняет сомнения в отношении законности оружия, может усилить защиту гражданского населения и комбатантов.

Оговорка Мартенса также делает моральные соображения юридически актуальными. Она закреплена в международных договорах, но еще требует оценки ситуации или технологии в соответствии с принципами гуманности и требований общественного сознания, которые составляют элементы морали. Питер Асаро, философ науки и техники, пишет, что оговорка Мартенса предлагает «моральное размышление о роли принципов гуманности и требований общественного сознания в формулировании и установлении нового [международного гуманитарного права]».[33] Хотя моральная оценка полностью автономных оружейных систем важна сама по себе, оговорка Мартенса также делает ее законным требованием в отсутствие конкретного закона.

Прецедент упреждающего запрета на ослепляющие лазеры

Государства, международные организации и гражданское общество ссылались на оговорку Мартенса в предыдущих обсуждениях о нерегулируемых, новых технологиях.[34] Они обнаружили, что это особенно применимо к обсуждениям ослепляющих лазеров в 1990-х годах. Эти группы прямо и косвенно ссылались на элементы оговорки Мартенса как на оправдание упреждающего запрещения ослепляющих лазеров. Протокол IV КНО, принятый в 1995 году, закрепляет этот запрет.[35]

В ходе круглого стола, организованного МККК в 1991 году, эксперты подчеркнули важность оговорки Мартенса. Адвокат МККК Луиза Досвальд-Бек утверждала, что «наложение конкретных ограничений на использование определенного оружия может основываться на соображениях политики» и «что критерии, закрепленные в оговорке Мартенса [должны] были особенно учитываться».[36]Другой участник сказал, что «в оговорке Мартенса конкретно рассматривается проблема человеческих страданий, так что «общественное сознание» относится к тому, что считается бесчеловечным или социально неприемлемым».[37]

Критики ослепляющих лазеров высказывались таким образом, который продемонстрировал, что это оружие вызывает обеспокоенность в вопросах соответствия принципам гуманности и требований общественного сознания. Несколько спикеров на заседаниях, организованных МККК, согласились с тем, что «оружие, предназначенное для ослепления, ... социально неприемлемо».[38] МККК сам «призывал к «сознательности человечества» при пропаганде запрета.[39] На первой обзорной Конференции КНО представители организаций ООН и гражданского общества назвали ослепляющие лазеры «бесчеловечными»,[40] «чудовищными для совести человечества»[41] и «неприемлемыми в современном мире».[42] Кампания МККК по информированию общественности была особенно эффективной при использовании фотографий солдат, ослепленных отравляющим газом во время Первой мировой войны, чтобы подчеркнуть тот факт, что ослепление солдат жестоко и бесчеловечно.

Такие характеристики ослепляющих лазеров были связаны с необходимостью упреждающего запрета. Например, в ходе прений на Первой обзорной Конференции Чили выразила надежду, что данная конференция «сможет разработать руководящие принципы для упреждающих мер, запрещающих разработку бесчеловечных технологий, и тем самым позволит избежать необходимости исправлять то зло, которое они могут причинить».[43] В резолюции декабря 1995 года, призывающей государства ратифицировать Протокол IV, Европейский парламент заявил, что «преднамеренное ослепление как метод ведения войны является чудовищным».[44] Используя формулировку оговорки Мартенса, Европейский парламент заявил, что «преднамеренное ослепление как метод ведения войны является ... противоречащим установившемуся обычаю, принципам гуманности и требованиям общественного сознания».[45] МККК приветствовал Протокол IV как «победу цивилизации над варварством».[46]

Обсуждения, касающиеся Протокола IV к КНО, подчеркивают актуальность оговорки Мартенса для нынешних дебатов по вопросу полностью автономных оружейных систем. Они показывают, что у государств-участников КНО есть история применения оговорки Мартенса к противоречивым видам оружия. Такие обсуждения также демонстрируют готовность этих государств упреждающе запрещать оружие, которое они считают противоречащим принципам гуманности и требованиям общественного сознания. Как будет обсуждаться более подробно далее, полностью автономные оружейные системы вызывают серьезные опасения относительно соответствия оговорке Мартенса. Тот факт, что их воздействие на вооруженные конфликты будет экспоненциально больше, чем у ослепляющих лазеров, должен лишь усилить срочность заполнения пробела в международном праве и введения явного запрета на такой вид оружия.[47]

IV. Принципы гуманности

Оговорка Мартенса разделяет принципы международного права на установившиеся обычаи, принципы гуманности и требования общественного сознания. Учитывая, что обычное право применимо даже без оговорки, в настоящем докладе проводится оценка полностью автономных оружейных систем по последним двум элементам. Оговорка Мартенса не определяет эти термины, но они являются предметом масштабного научного и правового обсуждения.

В соответствующей литературе освещены два ключевых компонента принципов гуманности. Субъекты деятельности обязаны: (1) относиться к другим гуманно и (2) проявлять уважение к жизни и достоинству человека. Из-за отсутствия эмоций и суждений у полностью автономных оружейных систем, сложно обеспечить соблюдение ими обоих компонентов.

Гуманное отношение

Определение

Первый принцип гуманности требует гуманного отношения к другим. Оксфордский словарь определяет «гуманность» как «качество быть гуманным; доброжелательность».[48] Обязательство относиться к другим гуманно является ключевым компонентом международного гуманитарного права и международного права в области прав человека.[49] Это обязательство, например, представлено в статье 3 и других положениях Женевских конвенций, многочисленных военных руководствах, международном прецедентном праве и Международном пакте о гражданских и политических правах.[50] Исходя из этих источников, оговорка Мартенса устанавливает, что к человеческим существам следует относиться гуманно, даже когда конкретного закона не существует.[51]

Для того, чтобы гуманно относиться к другим людям, необходимо проявлять сострадание и уметь применять правовые и этические суждения.[52] Сострадание, согласно основополагающим принципам МККК, это «состояние души, которое заставляет человека реагировать на страдание других».[53] Чтобы проявить сострадание, актор должен уметь испытывать эмпатию, то есть понимать и разделять чувства другого, и уметь реагировать в ответ.[54] Эта эмоциональная способность жизненно важна в ситуациях, когда принимаются решения об использовании силы.[55] Она побуждает акторов сознательно прилагать усилия для сведения к минимуму физического или психологического вреда, который они наносят людям. Действия с состраданием строятся на принципе, что «предпочтительнее захватить врага в плен, чем ранить его, а ранить его лучше, чем убить; что не-комбатантов по возможности не надо трогать; что раны должны быть настолько легкими, насколько это возможно, чтобы пострадавшие могли лечиться и излечиваться; и чтобы раны вызывали наименьшую возможную боль».[56]

В то время, как сострадание обеспечивает мотивацию действовать гуманно, правовое и этическое суждение предоставляет для этого средства. Чтобы действовать гуманно, актор должен принимать взвешенные решения о том, как минимизировать вред.[57] Такие решения основаны на способности воспринимать и понимать окружающую среду и применять «здравый смысл и знания о мире» к конкретным обстоятельствам.[58] Профессор философии Джеймс Мур отмечает, что акторы должны обладать способностью «идентифицировать и обрабатывать этическую информацию о различных ситуациях и принимать разумное решение о том, что должно быть сделано в этих ситуациях»[59]. Таким образом, правовое и этическое суждение помогает актору взвешивать факторы, чтобы убедиться в том, что обращение соответствует стандартам, требуемым состраданием. Суждение имеет жизненно важное значение для минимизации страданий: актор может воздержаться от причинения вреда людям, если сможет признать возможный вред и знает, как отреагировать.[60]

Применение в случае полностью автономных оружейных систем

Полностью автономные оружейные системы столкнутся с серьезными проблемами при соблюдении принципа гуманного обращения, поскольку сострадание и правовое и этическое суждение являются характеристиками человека. Сочувствие и сострадание к другим, которое оно порождает, приходят к людям естественно. Большинство людей испытывают физическую или психологическую боль, что заставляет их избегать причинения ненужных страданий другим. Их чувства превосходят национальные и другие идеи. Как отмечает МККК, «чувства и жесты солидарности, сострадания и самоотверженности можно найти во всех культурах».[61] Общее понимание людьми боли и страданий помогает им проявлять сострадание к окружающим и вдохновляет на взаимность, то есть, словами МККК, это является «совершенно естественным».[62]

Независимо от сложности дизайна полностью автономных оружейных систем, они не могут испытывать эмоции.[63] Есть кое-какие преимущества в том, что они невосприимчивы к эмоциям, таким как гнев и страх, но неспособность робота почувствовать сопереживание и сострадание серьезно ограничит его способность относиться к другим гуманно. Поскольку полностью автономные оружейные системы не являются живыми существами, они не могут знать физических или психологических страданий. В результате им не хватает общего опыта и понимания, которые заставляют людей относиться понимающе к боли других, чувствовать «волнение души» и побуждать проявлять сострадание к другим людям. Профессор в сфере информационных технологий Аманда Шарки отмечает, что «роботы, лишенные живых тел, не могут чувствовать боль или даже заботиться о себе, не говоря уже о переживаниях за других. Как они могут сопереживать боли или бедственному положению человека, если они не могут испытывать никаких эмоций?»[64] Таким образом, полностью автономные оружейные системы сталкиваются с серьезными трудностями в обеспечении того, чтобы их действия были человечными и соответствовали принципам гуманности.

Роботы также не будут обладать умением делать правовые и этические суждения, необходимые для минимизации нанесения вреда в каждом конкретном случае[65]. Ситуации, связанные с применением силы, особенно в вооруженном конфликте, часто сложны, непредсказуемы и могут быстро меняться. Таким образом, полностью автономные оружейные системы сталкиваются с серьезными препятствиями при принятии надлежащих решений в отношении гуманного обращения. Изучив многочисленные исследования, в которых исследователи пытались запрограммировать этику для роботов, Шарки обнаружила, что роботы, демонстрирующие поведение, которое может быть описано как «этическое» или «минимально этическое», могут работать только в ограниченных условиях. Шарки пришла к выводу, что у роботов ограниченные моральные возможности и поэтому их нельзя использовать в обстоятельствах, которые «требуют моральной компетентности и понимания окружающей социальной ситуации».[66] В соответствии с международным правом часто требуется субъективное принятие решений в сложных ситуациях. Полностью автономные оружейные системы будут обладать ограниченной способностью интерпретировать нюансы человеческого поведения, понимать политическую, социально-экономическую и экологическую динамику ситуации и понимать гуманитарные риски применения силы в конкретном контексте.[67] Эти ограничения ставят под сомнение способность оружия обеспечивать гуманное отношение к мирным жителям и комбатантам и соблюдать первый принцип гуманности.

Уважение жизни и достоинства человека

Определение

Второй принцип гуманности требует от акторов уважать как человеческую жизнь, так и человеческое достоинство. Кристоф Хейнс, ранее специальный докладчик по вопросу о внесудебных казнях, казнях без надлежащего судебного разбирательства или произвольных казнях, подчеркнул эти взаимосвязанные, но различные концепции, когда задал два вопроса относительно полностью автономных оружейных систем: «[М]огут ли [они] осуществлять или обеспечивают ли они правильное осуществление наведения цели?» и «Даже если они способны правильно осуществить наведение цели, должны ли машины управлять жизнью и смертью человека?».[68] В первую очередь рассматривается вопрос о том, соответствует ли оружие нормам международного права в отношении защиты жизни. Второй вопрос касается «способа наведения цели» и уважают ли эти системы человеческое достоинство.[69]

Для уважения человеческой жизни, акторы должны принимать меры для минимизации убийства.[70] Право на жизнь гласит, что «никто не может быть произвольно лишен своей жизни».[71] Это право ограничивает использование смертоносной силы обстоятельствами, в которых абсолютно необходимо защищать человеческую жизнь, и представляет собой последнее средство, применяемое по сопоставлению с масштабом угрозы.[72] Право на жизнь, закрепленное в статье 6 Международного пакта о гражданских и политических правах, признано «высшим правом» международного закона о правах человека, которое применяется при любых обстоятельствах. Во время вооруженного конфликта международное гуманитарное право определяет, что представляет собой необоснованное или произвольное лишение жизни. Необходимо, чтобы в ситуациях вооруженного конфликта акторы соблюдали правила разграничения, соразмерности и военной необходимости.[73]

Способность к суждениям и эмоциям способствует проявлению уважения к жизни, потому что она может сдерживать от убийства. Способность делать правовые и этические суждения может помочь актору определить, какой курс действий наилучшим образом защитит человеческую жизнь в бесконечном количестве потенциальных непредвиденных сценариев. Инстинктивное сопротивление убийству создает психологическую мотивацию для соблюдения норм международного права и иногда выходит за его рамки в целях сведения потерь к минимуму.

В соответствии с принципами гуманности акторы должны также уважать достоинство всех людей. Это обязательство основано на признании того, что каждый человек имеет присущую ему ценность, которая является универсальной и неприкосновенной.[74] Многочисленные международные документы, включая Всеобщую декларацию прав человека, Международный пакт о гражданских и политических правах, Венскую декларацию, Программу действий, принятую на Всемирной конференции по правам человека 1993 года, и региональные договоры закрепляют важность достоинства как основополагающего принципа прав человека.[75] Африканская хартия прав человека и народов прямо заявляет, что человек имеет «право на уважение его достоинства, присущего человеческой личности».[76]

Хотя уважение жизни человека включает в себя минимизацию числа смертей, избежание произвольных или необоснованных смертей, уважение человеческого достоинства требует оценки тяжести решения убить.[77] МККК пояснил, что здесь имеет значение «не только, убит или ранен человек, но и как он был убит или как получил ранения, включая процесс принятия этих решений».[78] Перед тем, как отнять жизнь, актор должен действительно понять ценность жизни человека и значимость ее утраты. Люди должны быть признаны уникальными индивидуумами, а не сводиться к объектам с просто инструментальной или никакой ценностью.[79] Если актор убивает, не принимая во внимание ценность отдельной жертвы, убийство подрывает фундаментальное понятие человеческого достоинства и нарушает этот принцип гуманности.

Применение в случае полностью автономных оружейных систем

Очень маловероятно, что полностью автономные оружейные системы смогут проявлять уважение к жизни и достоинству человека. Отсутствие у них правового и этического суждения также означает отсутствие способности уважать человеческую жизнь. Например, требование соразмерности международного гуманитарного права требует, чтобы командиры определяли, превышает ли ожидаемое военное преимущество ожидаемый гражданский вред в каждом конкретном случае. Учитывая бесконечное количество непредвиденных обстоятельств, которые могут возникнуть на поле боя, полностью автономные системы оружия невозможно предварительно запрограммировать для таких решений. Общепринятым стандартом для требования соразмерности является то, совершит ли «разумный военный командир» конкретную атаку,[80] разумность которой требует принятия решений на основе как этических, так и правовых соображений.[81] Полностью автономные оружейные системы, не имея возможности применить этот стандарт для взвешивания возможностей в целях установления соразмерности, вероятно, поставят под угрозу гражданских лиц и потенциально могут нарушить международное гуманитарное право[82].

У полностью автономных оружейных систем также не будет инстинктивного человеческого сопротивления убийству, которое может защитить человеческую жизнь при минимальных требованиях закона/[83] Стремление избежать убийства приходит к большинству людей естественным образом, потому что у них есть внутреннее понимание ценности, присущей человеческой жизни. Эмпирические исследования демонстрируют нежелание людей отнимать жизнь другого человека. Например, ушедший в отставку военнослужащий армии США, который провел обширные исследования по убийствам во время вооруженного конфликта, выяснил, что «внутри человека существует сильное сопротивление убийству своего собрата. Сопротивление настолько сильное, что во многих случаях солдаты умрут на поле битвы, прежде чем они смогут его преодолеть».[84] Являясь неодушевленными предметами, полностью автономные оружейные системы не могут потерять свою собственную жизнь или понять эмоции, связанные с потерей жизни любимого человека. Сомнительно, что хоть один программист сможет воспроизвести в роботе естественную склонность человека избегать убийств и защищать жизнь с учетом тех сложностей и нюансов, которые бы отражали принятие решений человеком.

Полностью автономные оружейные системы не могут уважать человеческое достоинство, которое связано с процессом, а не последствиями применения силы.[85] Будучи машинами, они не могут по-настоящему понимать ни ценности индивидуальной жизни, ни значимость ее утраты. Их решение по убийству будет продиктовано алгоритмами, без учета человечности конкретной жертвы.[86] Более того, это оружие будет запрограммировано заранее по сценарию и не сможет учитывать необходимость смертельной силы в конкретной ситуации. В своем выступлении на площадке КНО, специальный докладчик Кристоф Хейнс объяснил, что:

позволить машинам определять, когда и где применять силу против людей означает свести людей до объектов, которые рассматриваются как простые цели. Люди становятся нулями и единицами в цифровых данных оружия, которые запрограммированы заранее на использование силы, не имея возможности рассмотреть вопрос о том, нет ли другого выхода, так как они не обладают достаточным уровнем сознательного выбора, которые есть у людей в этом вопросе.[87]

Программа по противоминной деятельности в Канаде аналогичным образом сделала вывод о том, что «[р]азвертывание [полностью автономных оружейных систем] в бою свидетельствует о том, что никакому человеку, который является целью в таком случае, не гарантируется рассмотрение вопроса его жизни и смерти живым оператором, тем самым лишая этого человека его права на достоинство жизни».[88] Предоставление роботу возможности отнимать жизнь, без понимания неотъемлемой ценности этой жизни или необходимости ее отнять, показывает неуважение к жизни человека и унижает человека. Таким образом, это непримиримо с принципами человечности, закрепленными в оговорке Мартенса.

При использовании в соответствующих ситуациях ИИ может предоставить исключительные преимущества человечеству. Однако разрешение роботам принимать решения убивать людей будет противоречить оговорке Мартенса, которая объединяет закон и мораль. Ограничения в эмоциональных, этических возможностях и возможностях восприятии у данных машин значительно затрудняют их способность обращения с другими людьми и уважения жизни и достоинства человека. Следовательно, использование этого оружия будет несовместимым с принципами гуманности, изложенными в оговорке Мартенса.

V. Требования общественного сознания

Оговорка Мартенса гласит, что в отсутствии договорного права требования общественного сознания наряду с принципами гуманности защищают гражданских лиц и комбатантов. Ссылка на «общественное сознание» придает закону мораль и требует, чтобы при оценке средств и методов ведения войны учитывалось мнение граждан и экспертов, а также правительств. Реакция этих групп на перспективу полностью автономных оружейных систем дает понять, что разработка, производство и использование таких технологий вызовут серьезную обеспокоенность в соответствии с оговоркой Мартенса.

Определение

Требования общественного сознания относятся к общим моральным принципам, которые определяют действия государств и отдельных лиц.[89] Использование термина «сознание» означает, что требования основаны на чувстве морали, знании того, что правильно и что неправильно.[90] По мнению философа Питера Асаро, сознание подразумевает «чувство принуждения или веры в конкретное моральное обязательство или обязанность».[91] Прилагательное «общественное» разъясняет, что эти требования отражают обеспокоенность целого ряда людей и организаций. Основываясь на широко цитируемой работе юриста и эксперта по международному гуманитарному праву Теодора Мерона, в этом докладе рассматриваются два источника для определения того, что рассматривается как общественное сознание: мнение общественности и мнение правительств.[92]

Данные опроса и мнения экспертов служат доказательством общественного мнения.[93] Опросы показывают точку зрения и убеждения обычных людей. Они могут также пролить свет на тонкие нюансы в понимании этого вопроса простыми гражданами. Хотя опросы и информативны, сами по себе они не являются достаточными мерами общественного сознания, отчасти потому, что ответы могут зависеть от характера задаваемых вопросов и не обязательно отражают моральное соображение.[94] Заявления и действия экспертов, которые часто подробно обсуждали рассматриваемые вопросы, отражают более глубокое понимание. Их конкретный опыт может варьироваться от религии и технологии до закона, но у них есть глубокое знание этой темы.[95] Таким образом, взгляды, которые они озвучивают, могут пролить свет на моральные нормы, принятые информированной общественностью.[96]

Правительства формулируют свою позицию в рамках политики, а также в письменных заявлениях и устных выступлениях на дипломатических встречах и других публичных форумах. Их заявления отражают позиции стран, которые отличаются свои экономическим развитием, военной мощью, политическими системами, религиозными и культурными традициями и демографией. Правительственное мнение может помочь пролить свет на opinio juris (убежденность в правомерности), элемент обычного международного права, ссылающегося на убеждение государства в том, что определенная практика является юридически обязательной.[97]

Применение в случае полностью автономных оружейных систем

Позиции отдельных лиц и государств во всем мире продемонстрировали, что полностью автономные оружейные системы вызывают серьезные проблемы, когда речь идет о требованиях общественного сознания. Через опросы общественного мнения, открытые письма, устные и письменные заявления, подробные публикации и добровольно принятые руководящие принципы, представители общественности разделяют свое недовольство и возмущение в связи с перспективой использования этого оружия. Официальные лица из более чем 100 стран выразили аналогичную обеспокоенность и высказались в пользу введения ограничений на полностью автономные оружейные системы.[98] Хотя общественная оппозиция полностью автономным оружейным системам не является повсеместной, коллективно эти голоса показывают, что она широко распространена и ее распространение возрастает.[99]

Мнение общественности

Общественное противостояние разработке, производству и использованию полностью автономных оружейных систем имеет большое значение и набирает обороты. Несколько опросов общественного мнения показали, что люди против такого оружия.[100] Эти выводы отражены в заявлениях, сделанных лидерами в соответствующих областях разоружения и прав человека, мира и религии, науки, техники и промышленности. Источники, обсуждаемые ниже, хотя они и не являются исчерпывающими, иллюстрируют характер и спектр общественного мнения и свидетельствуют об общественном сознании.

Опросы

Опросы общественного мнения, проведенные по всему миру, подтвердили широкое противостояние разработке, производству и использованию этого оружия. Согласно этим опросам, большинство опрошенных считают перспективу делегирования решений о жизни и смерти машинам неприемлемой. Например, опрос американцев в 2013 году, проведенный профессором политологии Чарли Карпентером, показал, что 55 процентов респондентов выступают против «тенденции к использованию» полностью автономных оружейных систем.[101] Эта позиция разделялась примерно одинаково по гендерным и возрастным группам, а также политическим идеологиям. Интересно, что из самых активных групп, выступающих против, были военнослужащие, находящиеся на действительной службе, которые понимают реальность вооруженного конфликта не понаслышке; 73% высказались против полностью автономных оружейных систем.[102] Большинство респондентов опроса также поддержали кампанию по запрещению оружия.[103] Более ранний опрос, проведенный на национальном уровне и охвативший около 1000 бельгийцев, результаты которого были опубликованы 3 июля 2018 года, показал, что 60 процентов респондентов считают, что «Бельгия должна поддерживать международные усилия по запрещению разработки, производства и использования полностью автономных оружейных систем». Только 23 процента не согласились с этим.[104]

Аналогичные результаты показали и международные опросы. В 2015 году Инициатива «Открытая робототехника» провела опрос более 1000 человек из 54 разных стран и выяснила, что 56 процентов респондентов выступают против разработки и использования оружия, называемого автономными системами оружия летального действия.[105] Тридцать четыре процента всех респондентов считают разработку и использование такого оружия неприемлемым, потому что «именно люди должны быть теми, кто принимает решения о жизни и смерти».[106] Среди других мотивов, упоминающихся не так часто – ненадежность оружия, риск его распространения и отсутствие подотчетности[107]. Еще более крупный опрос Ipsos дал аналогичные результаты в 2017 году, когда было опрошено 11 500 человек из 25 стран.[108] Этот опрос объяснил, что Организация Объединенных Наций делает обзор «стратегических, правовых и моральных последствий автономных оружейных систем» (что эквивалентно полностью автономным оружейным системам) и спрашивал участников об их мнении в отношении использования оружия. Пятьдесят шесть процентов высказались против.[109]

Неправительственные и международные организации

Предоставляя дополнительные доказательства обеспокоенности в отношении требований общественного сознания, эксперты из целого ряда областей вынуждены, особенно по моральным соображениям, требовать запрета на разработку, производство и использование полностью автономного оружия. Кампания «Остановить роботов-убийц», коалиция гражданского общества из 75 НПО, возглавляет усилия по запрещению полностью автономных оружейных систем.[110] Ее члены – НПО – работают более чем в 30 странах и включают в себя группы, обладающие опытом в области гуманитарного разоружения, мира и разрешения конфликтов, технологий, прав человека и других соответствующих областях.[111] Ее координатором выступает Хьюман Райтс Вотч, которая была одним из основателей кампании в 2012 году. За последние шесть лет организации – члены кампании сфокусировали внимание на многочисленных проблемах, связанных с полностью автономными оружейными системами, посредством десятков публикаций и заявлений, сделанных на дипломатических встречах и мероприятиях ООН, в социальных сетях и на других аренах[112].

В то время как разные проблемы находят отклик у разных людей, Стив Гуз, директор Отдела вооружений Хьюман Райтс Вотч, подчеркнул важность оговорки Мартенса в своем заявлении на совещании правительственных экспертов КНО в апреле 2018 года. Гуз сказал:

Существует множество причин отказаться [от автономных систем оружия летального действия] (сюда входят правовые, подотчетные, технические, оперативные проблемы, вопросы распространения и международной безопасности), но этические и моральные нормы, которые порождают чувство чудовищности, перевешивают все. Эти этические нормы должны побудить Высокие Договаривающиеся Стороны Конвенции ООН об обычных вооружениях принять во внимание оговорку Мартенса в международном гуманитарном праве, согласно которому оружие, противоречащее принципам гуманности и требованиям общественного сознания, не должно разрабатываться.[113]

МККК призвал государства провести оценку полностью автономных оружейных систем на предмет их соответствия оговорке Мартенса и отметил, что «с точки зрения общественного сознания возникает чувство глубокого дискомфорта, когда какая-либо система оружия применяет силу без контроля со стороны человека».[114] МККК неоднократно подчеркивал юридическую и этическую потребность в контроле со стороны человека над такими ключевыми функциями, как выбор и поражение цели. В апреле 2018 года Комитет дал понять, что «минимальный уровень контроля со стороны человека необходим для обеспечения соблюдения норм международного гуманитарного права, которые защищают гражданских лиц и комбатантов в вооруженном конфликте, и этической приемлемости с точки зрения принципов гуманности и требований общественного сознания».[115] МККК пояснил, что международное гуманитарное право «требует, чтобы те, кто планировал, принимал решения и совершал нападения, принимали определенные решения при применении норм при начале нападения. Этические соображения параллельны этому требованию, человеческий фактор и намерение человека должны быть сохранены при принятии решений о применении силы».[116] МККК пришел к выводу, что система оружия без контроля со стороны человека «незаконна по самой своей природе».[117]

Мировые и религиозные лидеры

В 2014 году более 20 человек и организаций, получивших Нобелевскую премию мира, опубликовали совместное письмо с заявлением о том, что они «всецело поддерживают цель упреждающего запрета на полностью автономные оружейные системы» и считают «вопиющим фактом то, что человек продолжает исследования и разработку смертоносных машин, которые могут убивать людей без вмешательства человека».[118] Среди лиц, подписавших это письмо, есть американский активист Джоди Уильямс, которая возглавляла гражданское общество по вопросу запрета противопехотных мин, а также главы государств и политики, люди правовой сферы и мирные активисты, адвокат, журналист и церковный лидер.[119] Организации, подписавшие этот документ, в числе которых Пагуошская конференция по науке и глобальным проблемам и Нобелевская женская инициатива, которые стали инициаторами написания письма, являются членами руководящего комитета кампании «Остановить роботов-убийц».

Религиозные лидеры также объединились против полностью автономных систем оружия. В 2014 году более 160 лидеров подписали «межрелигиозную декларацию, призывающую государства работать над глобальным запретом на полностью автономные оружейные системы».[120] Используя формулировки, подразумевающие обеспокоенность насчет принципов гуманности, декларация описывает такое оружие как «оскорбление человеческого достоинства и принципа святости жизни».[121] Декларация далее критикует идею передачи решений о жизни и смерти машине, потому что полностью автономные оружейные системы «не обладают моральными качествами и, как следствие, не могут нести ответственность при лишении жизни невинного человека».[122] В списке лиц, подписавших документ, были представители буддизма, католицизма, ислама, иудаизма, протестантизма и квакеризма. Архиепископ Десмонд Туту подписал и эту декларацию, и письмо лауреатов Нобелевской премии мира.

Эксперты по науке и технологиям

Лица с опытом в технологической сфере также выразили свое несогласие с полностью автономными оружейными системами. Международный комитет по контролю за роботизированными вооружениями (МККРВ), члены которого изучают технологии различных дисциплин, заявил об опасности в 2013 году, вскоре после того, как он стал соучредителем кампании «Остановить роботов-убийц».[123] МККРВ опубликовал заявление, одобренное более чем 270 экспертами, в которых содержится призыв к запрету на разработку и использование полностью автономных оружейных систем.[124] Члены МККРВ отметили «отсутствие четких научных доказательств того, что роботизированное вооружение имеет или может иметь в обозримом будущем функциональность, необходимую для точной идентификации целей, ситуационной осведомленности или для принятия решений относительно пропорционального применения силы» и пришел к выводу, что «[р]ешения о применении силы не должны делегироваться машинам».[125] Хотя в этом заявлении подчеркивается, что основное внимание уделяется технологиям, невозможность принятия решений о пропорциональности, как обсуждалось выше, может противоречить принципам уважения жизни и принципам гуманности.

В 2015 году еще большая группа исследователей ИИ и робототехники опубликовала открытое письмо. По состоянию на июнь 2018 года более 3500 ученых, а также более 20000 человек подписали этот призыв о запрете.[126] В данном письме исследователи предупреждают, что эти машины могут стать «автоматом Калашникова завтрашнего дня», если их развитие не будет предотвращено.[127] В нем говорится, что, хотя подписавшие стороны «полагают, что ИИ обладает огромным потенциалом принесения пользы человечеству во многих отношениях, они «считают, что военная гонка вооружений не будет полезной для человечества. Существует много способов, с помощью которых ИИ может сделать поле боевых действий более безопасным для людей, особенно для гражданских лиц, без создания новых инструментов для убийства людей».[128]

В дополнение к требовательным действиям других, тысячи технических экспертов обязались не участвовать в действиях, которые будут способствовать развитию полностью автономных оружейных систем. На всемирном конгрессе, состоявшемся в Стокгольме в июле 2018 года, ведущие исследователи ИИ дали обещание «не участвовать и не поддерживать разработку, производство, торговлю или использование автономных систем оружия летального действия».[129] К концу месяца более 2850 экспертов, ученых в сфере ИИ и других лиц, а также 223 технологических компаний, предприятий и организаций из не менее 36 стран подписали письмо. В данном обязательстве говорится о морали, подотчетности, распространении и проблемах, связанных с безопасностью; был сделан вывод о том, что «решение о принятии человеческой жизни никогда не должно быть передано машине». Там говорится: «В этой ситуации есть моральный компонент, мы не должны позволять машинам принимать жизненно важные решения, за которые будут нести ответственность другие или не будет нести никто».[130] Согласно Институту «Будущее жизни», на сайте которого опубликовано это обязательство, оно необходимо, потому что «политики до сих пор не смогли ввести «положения и законы против автономных систем оружия летального действия».[131]

Индустрия

Высокопрофильные технологические компании и их представители высказывают свою критику в адрес полностью автономных оружейных систем по разным причинам. Канадский производитель робототехники ClearPath Robotics стал первой компанией, публично отказавшейся от производства «вооруженных роботов, которые исключают людей из процесса принятия решения».[132] В 2014 году компания дала обещание сделать выбор в пользу «ценности этики, а не в пользу потенциальных будущих доходов».[133] В письме-обращении к общественности компания заявила, что ее мотивировало убеждение о том, что «разработка роботов-убийц неразумна, неэтична и должна быть запрещена в международном масштабе». Компания ClearPath продолжила развивать свои идеи:

[Б]удет ли у робота мораль, здравый смысл или эмоциональное понимание, необходимые для противостояния приказам, которые являются неправильными или бесчеловечными? Нет. Могут ли компьютеры принимать субъективные решения, необходимые для проверки легитимности целей и обеспечения пропорционального применения силы в обозримом будущем? Нет. Может ли эта технология вести за собой тех, кто ценит человеческую жизнь? Откровенно говоря, мы в этом сомневаемся.[134]

Письмо показывает, что полностью автономные оружейные системы ведут к проблемам, как в отношении соответствия принципам гуманности, так и в отношении требований общественного сознания.

В августе 2017 года учредители и главные исполнительные директора (генеральные директора) 116 компаний ИИ и робототехники опубликовали письмо с призывом к государствам-участникам КНО принять меры в отношении автономных оружейных систем.[135] Письмо начинается с заявления: «Мы, компании, строящие свои технологии на искусственном интеллекте и робототехнике, которые могут быть переориентированы на разработку автономных оружейных систем, чувствуем особую ответственность за повышение этой опасности».[136] В письме подчеркивается опасность, которую автономные оружейные системы представляют для гражданских лиц, гонки вооружений и возможности дестабилизирующих эффектов. Письмо предупреждает, что «если этот ящик Пандоры будет открыт, его будет сложно закрыть».[137] Аналогичным образом, в 2018 году Скотт Феникс, генеральный директор Vicarious, выдающейся компании по разработке ИИ, отнес разработку автономного оружия к числу «самых худших идей мира» из-за вероятности недостатков в кодах и их уязвимости к взлому.[138]

Компания Google и компании группы Alphabet неоднократно находились в центре дебатов по поводу полностью автономных оружейных систем. DeepMind – исследовательская компания ИИ, была приобретена Google в 2014 году. В 2016 году она представила доказательства в парламентский комитет Великобритании, в котором описала запрет на автономное оружие как «лучший подход к предотвращению вредных последствий, которые могут возникнуть в результате разработки и использования такого оружия».[139] Компания DeepMind выразила особую обеспокоенность в связи с последствиями действий такого оружия для «глобальной стабильности и сокращения конфликтов».[140] Два года спустя более 3000 сотрудников Google выразили протест против участия компании в проекте «Проджект Мавен», в рамках программы Министерства обороны США, целью которой является использование ИИ для автономной обработки видеоматериалов, снятых разведывательными беспилотными летательными аппаратами. Сотрудники утверждали, что компания «не должна участвовать в войне»,[141] более 1100 ученых поддержали их в отдельном письме.[142] В июне 2018 года компания Google согласилась прекратить свое участие в проекте «Проджект Мавен» после истечения срока действия контракта в 2019 году, компания опубликовала этические принципы, обязывающие не разрабатывать ИИ для использования в оружейных системах. В принципах утверждается, что Google «не разрабатывает ИИ для использования в создании оружия» и «не будет разрабатывать или использовать ИИ» для технологий, которые наносят «общий ущерб» или «противоречат общепринятым принципам международного права и прав человека».[143]

Инвесторы в технологической отрасли также начали реагировать на этические проблемы, вызванные полностью автономными оружейными системами. В 2016 году Совет по этике Пенсионного фонда правительства Норвегии объявил, что он будет контролировать инвестиции в развитие этого оружия, чтобы решить, противоречат ли они положениям Совета.[144] Йохан Х. Андресен, председатель Совета, повторил эту позицию в панельной презентации для делегатов КНО в апреле 2018 года.[145]

Мнение правительств

Правительства всего мира все чаще разделяют мнение экспертов и широкой общественности о том, что разработка, производство и использование оружия без значимого контроля со стороны человека неприемлемы. По состоянию на апрель 2018 года 26 стран – из Африки, Азии, Европы, Латинской Америки и Ближнего Востока – призвали к упреждающему запрету на полностью автономные оружейные системы.[146] Кроме того, более 100 государств, в том числе участники Движения неприсоединения (ДН), призвали к разработке юридически обязательного инструмента по такому оружию. В совместном заявлении члены ДН указали «этические, правовые, моральные и технические аспекты, а также аспекты международного мира и безопасности» как проблемы, вызывающие озабоченность.[147] Хотя полный анализ правительственных вмешательств за последние пять лет выходит за рамки настоящего доклада, в целом, эти заявления продемонстрировали, что страны выступают против утраты контроля со стороны человека по моральными, а также правовым, техническим и другим причинам. Мнения этих правительств, отражающие общественные интересы, поддерживают аргумент о том, что полностью автономные оружейные системы нарушают требования общественного сознания.

Принципы, закрепленные в оговорке Мартенса, сыграли определенную роль в международных дискуссиях о полностью автономных оружейных системах с самого начала в 2013 году. В этом году Кристоф Хейнс, ранее являвшийся Специальным докладчиком по вопросу о внесудебных казнях, представил Совету ООН по правам человека доклад о полностью автономных оружейных системах, которые он назвал «смертельной автономной робототехникой».[148] Подчеркивая важность контроля со стороны человека над решениями о жизни и смерти, Хейнс объяснил, что «полномочия при принятии решения отнять жизнь у человека или подвергнуть его другим серьезным последствиям должны быть возложены на людей; это основополагающее допущение большинства правовых, моральных и других кодексов».[149] Он продолжил: «Делегирование этого процесса делает вооруженный конфликт еще более бесчеловечным и исключает момент взвешивания решений в тех случаях, когда это может быть целесообразным. У машин нет нравственности и смертности, следовательно, у них не должно быть власти над жизнью и смертью людей».[150] Хейнс также признал оговорку Мартенса как одно из правовых оснований для своего решения.[151] В докладе 2013 года содержится призыв к мораторию на разработку полностью автономных оружейных систем до тех пор, пока не будут созданы «согласованные на международном уровне рамочные документы».[152] В 2016 году в совместном отчете Хейнс и Майна Киай, Специального докладчика ООН по вопросу о свободе мирных собраний и объединений, был сделан еще один шаг вперед — были озвучены рекомендации «запретить автономные оружейные системы, которые не обеспечиваются значимым контролем со стороны человека».[153]

В мае 2013 года в ответ на отчет Хейнса Совет ООН по правам человека провел первые обсуждения по оружейным системам на международном уровне.[154] Из 20 стран, которые высказали свои позиции, многие озвучили свою обеспокоенность по поводу новых технологий. Они чаще использовали формулировки, связанный с оговоркой Мартенса или с моралью в целом. Эквадор прямо указал на элементы оговорки Мартенса и заявил, что передача принятия решений о жизни и смерти машинам будет противоречить общественному сознанию.[155] Индонезия высказала возражения, связанные с принципами гуманности, о которых говорилось выше. Она подвергла критике «возможное далеко идущее воздействие на общественные ценности, в том числе на защиту и ценность жизни», которое может возникнуть в результате использования этого оружия.[156] Россия рекомендовала уделить «особое внимание» «серьезным последствиям для общественных устоев, включая отрицание человеческой жизни».[157] Пакистан призвал к запрету, основанному на прецеденте упреждающего запрета на ослепляющие лазеры, что в значительной степени было мотивировано оговоркой Мартенса.[158] Бразилия также затронула вопросы морали; было сказано: «Если убийство одного человека другим было проблемой, которую с незапамятных времен пытались решить с помощью правовых, моральных и религиозных кодексов, можно представить то множество дополнительных проблем, которые возникнут, если роботы получат власть над жизнью и смертью человека».[159] Хотя государства-члены Совета по правам человека также рассматривали другие важные риски, связанные с полностью автономными оружейными системами, особенно в отношении безопасности, вопрос морали был доминирующим.[160]

Со времени проведения сессии Совета по правам человека в 2013 году большинство дипломатических дискуссий проводилось под эгидой Конвенции ООН об обычных вооружениях.[161] Государства-участники КНО провели три неофициальных совещания экспертов в отношении того, что они называют «автономными системами оружия летального действия» в период между 2014 и 2016 годами.[162] На своей Конференции по обзору 2016 года они договорились о формализации обсуждений в Группе правительственных экспертов, что, как ожидается, приведет к результатам, таким как новый протокол КНО.[163] Более 80 государств приняли участие в последнем заседании группы в апреле 2018 года. На этом совещании Австрия отметила, что «участие КНО по вопросу автономных систем оружия летального действия свидетельствует о высокой степени обеспокоенности риском, связанным с таким оружием».[164] Это также служит признаком того, что общественное сознание выступает против этой технологии.

Государства-участники КНО подчеркивали важность оговорки Мартенса на каждом из своих совещаний по автономным системам оружия летального действия. Например, на первой встрече в мае 2014 года Бразилия описала оговорку Мартенса как «основополагающий принцип» международного гуманитарного права, который «позволяет нам безопасно перемещаться в новых и опасных водах» и чувствовать уверенность в том, что человек остается защищенным принципами гуманности и требованиями общественного сознания».[165] Мексика заявила: «нет абсолютно никаких сомнений в том, что развитие этих новых технологий должно соответствовать принципам оговорки Мартенса.[166] На втором совещании экспертов КНО в апреле 2015 года Россия описала пункт Мартенса как «неотъемлемую часть обычного международного права».[167] Приняв узкую интерпретацию положения, Соединенные Штаты заявили, что «оговорка Мартенса не является нормой международного права, которая запрещает какое-либо конкретное оружие, а, тем более, оружие, которое в настоящее время не существует». Тем не менее, США признали, что «принципы гуманности и требования общественного сознания обеспечивают надлежащую и важную парадигму для обсуждения моральных или этических вопросов, связанных с использованием автономных технологий в войне».[168]

Несколько государств-участников КНО основывают свои возражения против полностью автономных оружейных систем на оговорке Мартенса и ее элементах. В совместном заявлении в апреле 2018 года Африканская группа заявила, что «принципы гуманности и требования общественного сознания, сформулированные в оговорке [Мартенса], должны учитываться со всей серьезностью».[169] Африканская группа призвала к упреждающему запрету на автономные системы летального вооружения, заявив, что ее члены признали, что это «бесчеловечно, чудовищно, отвратительно и идет в разрез с общественным сознанием, что люди передадут контроль машинам, позволяя машинам решать, кто живет или умирает, сколько жизней и чьи жизни допускаются в качестве сопутствующих потерь при применении силы».[170] Ватикан осудил полностью автономные оружейные системы, потому что они «никогда не смогут быть морально ответственным субъектом. Уникальный человеческий потенциал для морального суждения и принятия этических решений – это не просто сложный набор алгоритмов, такая способность не может быть замещена или запрограммирована в машине». Ватикан предупредил, что автономные оружейные системы могут считать нормальным и приемлемым «поведение, запрещаемое международным правом, или которое, хотя и не оговорено явно, по-прежнему запрещено требованиями морали и общественного сознания».[171]

На совещании в апреле 2018 года другие государства поднимали вопросы относительно оговорки Мартенса более размыто. Греция, например, заявила, что «важно обеспечить, чтобы командиры и операторы оставались в цикле процесса принятия решений, чтобы обеспечить надлежащее человеческое суждение об использовании силы не только по причинам, связанным с подотчетностью, но главным образом, чтобы защищать достоинство человека при принятии решения о жизни или смерти».[172]

В течение последних пяти лет государства-участники КНО рассматривали множество других проблем, связанных с автономными системами оружия летального действия. Они подчеркнули, в частности, проблемы соблюдения международного гуманитарного права и международного права по правам человека, потенциального пробела в подотчетности, риск гонки вооружений, снижение порога развязывания войны и уязвимость данного оружия к взлому. Вместе с оговоркой Мартенса эти вопросы привели к сближению взглядов о необходимости сохранения какой-либо формы контроля со стороны человека над системами вооружений с применением силы. В апреле 2018 года Пакистан отметил, что «между Высокими Договаривающимися Сторонами распространяется общее мнение, что оружие с автономными функциями должно всегда оставаться под непосредственным контролем и надзором со стороны человека и должно соответствовать международному праву».[173] Аналогичным образом, Европейский союз заявил, что его члены «твердо убеждены в том, что люди должны принимать решения в отношении применения смертоносной силы, осуществлять достаточный контроль над системами смертоносного оружия, которые они используют, и нести ответственность за решения в отношении жизни и смерти».[174]

В 2018 году также наблюдаются усиленные призывы со стороны парламентариев и ООН к обеспечению контроля со стороны человека. 4 июля Комитет обороны Парламента Бельгии принял резолюцию, запрашивающую Правительство поддержать международные усилия по запрещению использования полностью автономных оружейных систем.[175] На следующий день Европейский парламент проголосовал за то, чтобы рекомендовать Совету Безопасности ООН:

работать над международным запретом в отношении оружейных систем, которые не обеспечивают контроля со стороны человека над применением силы в разных ситуациях, как требует того Парламент, а также при подготовке соответствующих совещаний на уровне ООН срочно разработать и принять общую позицию по автономным оружейным системам и выступить на соответствующих форумах единогласно и действовать соответственным образом.[176]

В своей повестке дня разоружения 2018 года Генеральный секретарь ООН отметил: «Похоже, все стороны согласны с тем, что, как минимум, необходим надзор со стороны человека за использованием силы». Он предложил поддержать усилия государств «разработать новые меры, в том числе политически или юридически обязывающие меры для обеспечения постоянного контроля со стороны человека над применением силы».[177] Хотя этот термин еще предстоит определить, требование «контроль со стороны человека» фактически является тем же самым, что и запрещение оружия без такого контроля. Тем самым, широко распространенное согласие о необходимости контроля со стороны человека указывает на то, что полностью автономные оружейные системы противоречат требованиям общественного сознания.

VI. Необходимость в договоре об упреждающем запрете

Оговорка Мартенса заполняет пробел в том случае, когда существующие договоры не охватывают некую новую ситуацию или технологию. В таких случаях принципы гуманности и требования общественного сознания служат руководством для толкования международного права и устанавливают стандарты, с помощью которых можно оценивать средства и методы войны. При этом они обеспечивают основу для разумной защиты гражданских лиц и комбатантов. Эта оговорка, которая является положением международного гуманитарного права, также включает моральные соображения в правовой анализ.